Neuronale Netzwerke, einschliesslich der beeindruckenden Large Language Models, sind eine Art digitale Gehirne, vollgepackt mit Parametern, die den Neuronen in unserem Gehirn ähneln. Ein Grössenvergleich zur Biologie verdeutlicht, wie enorm gross und leistungsfähig diese neuen Modelle geworden sind.

Let's dive in...

Um den Hype um ChatGPT besser zu verstehen, ist es wichtig, die technischen Prinzipien hinter LLMs zu kennen. Es geht nicht darum, ein Experte zu werden, sondern die Konzepte zu verstehen, um Aussagen von Herstellern hinterfragen zu können.

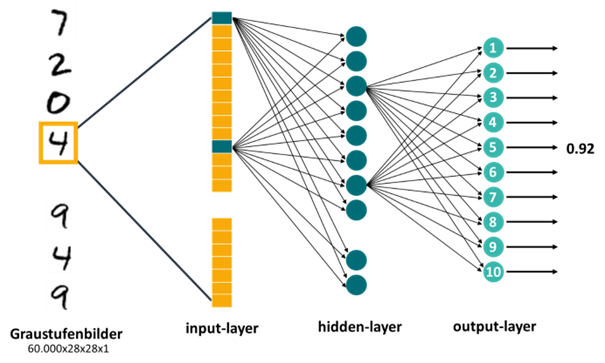

Stell dir ein Tiefes Neuronales Netzwerk wie ein komplexes Netz aus unzähligen Knöpfen vor, die feinjustiert werden müssen, ähnlich den Neuronen im menschlichen Gehirn. Diese «Knöpfe», unsere Parameter, sind mit Ein- und Ausgängen versehen und operieren auf der Basis von Wahrscheinlichkeiten. Um sinnvolle Ergebnisse zu liefern, müssen sie sorgfältig während des Trainings eingestellt werden. Dabei wird dem Model beigebracht, welche Ausgaben es zu bestimmten Eingaben liefern soll, ein bisschen wie das Einstellen eines riesigen Mischpults bei einem Konzert, um die perfekte Harmonie zwischen der Performance der Band und dem Genuss der Zuhörer zu erreichen.

Stell dir vor, du möchtest einem Netzwerk beibringen, die Ziffern 0-9 zu erkennen. Zuerst werden Bilder der Ziffern in Vektoren umgewandelt, wobei jeder Pixel entweder eine 0 oder eine 1 darstellt. Diese Vektoren sind dann mit Parametern und mehreren Schichten verbunden, die einschätzen, um welche Zahl es sich handelt. Durch das Training mit zahlreichen Bildern lernt das Modell, seine Parameter fein abzustimmen. Aber sei vorsichtig: Zu langes Training kann zu einer Überanpassung führen und die Genauigkeit des Modells verringern.

Eine Einführung durch Studenten in die Programmierung dieses kleinen KI-Beispiel findet sich hier:

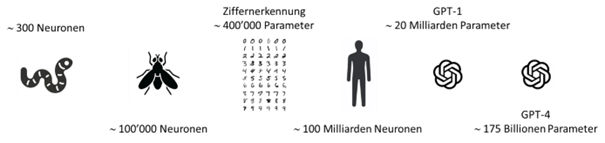

Ein Modell zur Erkennung von Ziffern kann mit zwei Schichten und etwa 400.000 Parametern erstellt werden. Zum Vergleich: Eine Fliege hat rund 100.000 Neuronen, ein Mensch etwa 100 Milliarden. GPT-3 arbeitet mit 175 Milliarden Parametern, GPT-4 sogar mit 1,76 Billionen – eine schier unvorstellbare Grössenordnung.

Einem Bericht von Nvidia und der Stanford University zufolge würde das Training eines Sprachmodells wie GPT-4, welches mit gewaltigen 175 Milliarden Parametern ausgestattet ist, auf einer NVIDIA V100 GPU-Prozessorarchitektur unglaubliche 288 Jahre in Anspruch nehmen. Diese Einschätzung unterstreicht, warum Nvidias Aktien in den letzten Jahren stark gestiegen sind, angesichts der enormen Rechenleistung, die für solche KI-Trainingsprozesse benötigt wird. Es verdeutlicht auch, warum die USA darauf bedacht sind, den Zugang zu diesen hochleistungsfähigen Chips ausserhalb ihres Einflussbereiches, insbesondere in China, zu kontrollieren.

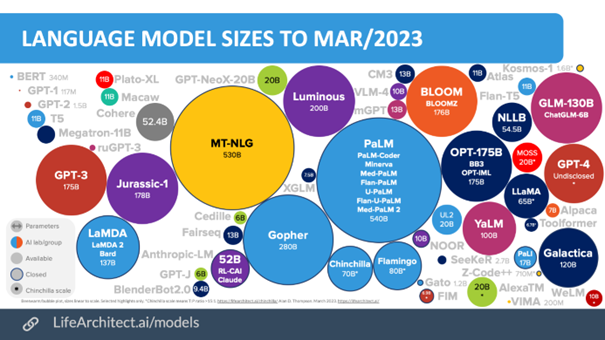

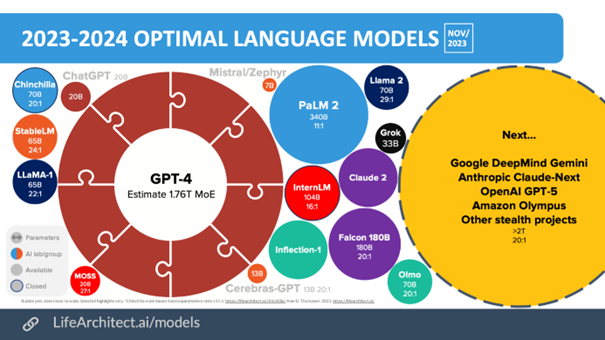

Aktuell erleben wir eine regelrechte Explosion bei der Anzahl der Grossen Sprachmodelle (LLMs), und die Komplexität dieser Modelle, gemessen an der Zahl ihrer Parameter, wächst stetig. Alan Thompson, ein Experte auf dem Gebiet der künstlichen Intelligenz, hat eine Übersicht der bedeutendsten Modelle erstellt. In dieser Darstellung entspricht die Fläche jedes Kreises der Anzahl der Parameter des jeweiligen Modells, was einen visuellen Vergleich ihrer Grösse ermöglicht.

Key Takeaways

- Die Parameter einer KI entsprechen einer Art künstlicher Neuronen.

- Aktuelle grosse Modelle haben mehr Parameter als das menschliche Gehirn Neuronen hat.

- Für den richtigen Output müssen alle Parameter beim Training optimal eingestellt werden.

👉 Demnächst auf unserem Blog:

Im vierten Blogbeitrag «Die Welt der Tokens: AI & LLMs für Entscheidungsträger» geht es um das Verständnis von Tokens. Neuronale Netzwerke, besonders grosse Sprachmodelle, sind aus Parametern aufgebaut und "nähren" sich von Tokens. Die Menge dieser Tokens zeigt, wie viele Informationen – vergleichbar mit Büchern – die KI "gelesen" hat.

Stelle sicher, dass du keinen Beitrag zum AI verpasst und in Zukunft direkt über Neuigkeiten im Bereich Künstliche Intelligenz informiert bleibst. Registriere dich jetzt für das kostenlose Blog-Abo.

✍️✍️✍️

Hast du weitere Fragen? Dann zögere nicht und kontaktiere uns. Wir helfen dir gerne unter marketing@bithawk.ch weiter.