Grosse Sprachmodelle finden vielfältige Anwendungen. Das RAG-Modell stellt dabei nicht ein neues AI-Modell dar, sondern eine Methode, wie man ein grosses

Sprachmodell geschickt in eine Gesamtarchitektur integriert. Microsoft M365 Copilot ist ein Beispiel, das auf einem solchen RAG-Modell aufbaut.

Let's dive in...

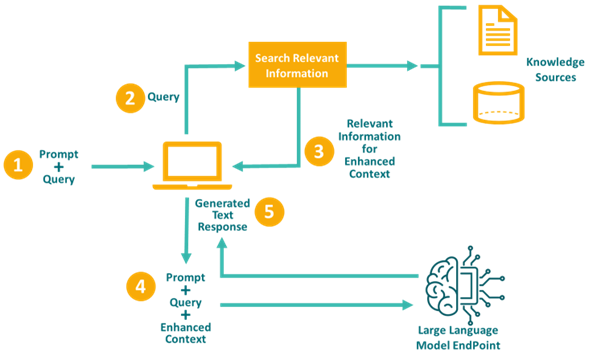

Das RAG-Modell (Retrieval-Augmented Generation) in der AI ist ein hybrider Ansatz, der die Leistungsfähigkeit grosser Sprachmodelle mit der Fähigkeit kombiniert, Informationen aus einer Datenbank abzurufen. Dazu werden zunächst relevante Dokumente oder Daten aus einer Wissensquelle abgerufen und dann mithilfe eines LLM Antworten erstellt, die sowohl auf der Eingabeanfrage als auch auf den abgerufenen Informationen basieren. Dieser Ansatz verbessert die Fähigkeit des Modells, genauere, sachkundigere und kontextrelevante Antworten zu geben.

Microsoft Copilot M365 verwendet ein RAG-Modell (Retrieval-Augmented Generation), das sowohl intelligente Suchtechnologien als auch Datenschutz effektiv integriert. Das System beginnt mit einer intelligenten Suche im eigenen Tenant, um die Anfrage oder den Prompt zu erweitern. Diese angereicherten Informationen werden dann an GPT-4 gesendet, um eine Antwort zu generieren, die wiederum im eigenen Tenant empfangen wird.

Dieser Ansatz ist aus technischer Sicht besonders vorteilhaft für den Datenschutz, da die Suche ausschliesslich innerhalb des eigenen Tenants und basierend auf den Berechtigungen des jeweiligen Benutzers stattfindet. Die Ergebnisse, die auch der Benutzer selbst hätte finden können, verlassen nie die eigene Umgebung. Die relevanten und wichtigen Suchergebnisse werden verschlüsselt an GPT-4 von Microsoft übermittelt, und die Antwort wird ebenfalls verschlüsselt zurückgesendet. Vorausgesetzt, dass Microsoft die Eingabe- und Ausgabedaten jeweils löscht, sollten aus technischer Sicht datenschutzrechtlich keine Bedenken bestehen. Aus juristischer Sicht müssen natürlich die nötigen Verträge vorhanden sein.

Ein sehr guter Blog über dieses Thema findet man bei den Vischer Anwälten.

Das RAG-Modell hat einige Vorteile:

- Genauigkeit: RAG-Modelle verbessern die Genauigkeit, indem sie relevante Informationen aus verschiedenen Quellen einbeziehen.

- Aktualität: Sie bieten aktuellere Antworten, da sie auf die neuesten Daten zugreifen können.

- Datenschutz: Bieten Datenschutzvorteile, da sie innerhalb geschützter Datenräume arbeiten können.

- Anwendungsvielfalt: Flexibel einsetzbar, von Chatbots bis zu Empfehlungssystemen.

Natürlich gibt es auch Nachteile:

- Komplexität: Sind in der Entwicklung und Implementierung komplexer als Standard-AI-Modelle.

- Abhängigkeit von Datenquellen: Ihre Effektivität hängt von der Qualität der Datenquellen ab.

- Datenschutzprobleme: Bedürfen einer sorgfältigen Konfiguration, um Datenschutz zu gewährleisten.

In meiner Einschätzung sind die Abhängigkeit von Datenquellen, das Risiko von Informationsverzerrungen sowie Datenschutzbedenken von grosser Bedeutung. Dies bedeutet konkret, dass eine M365-Implementierung äusserst sorgfältig durchgeführt werden muss. Ein fehlerfreies und umfassendes Sicherheitskonzept ist unerlässlich. Zudem ist es wichtig, keine veralteten Datenbestände zu bewahren, die möglicherweise zu Informationsverzerrungen führen könnten. Solche «Datenfriedhöfe» müssen identifiziert und bereinigt werden, um die Integrität und Zuverlässigkeit der Daten zu gewährleisten.

Jede Firma, die Microsoft M365 nutzt, hat heute schon die Möglichkeit, sich diesen wichtigen Themen wie Datenqualität, Datenorganisation und Sicherheitskonzept zu widmen. BitHawk bietet hierbei professionelle Unterstützung und kann Firmen in diesen Schlüsselbereichen effektiv zur Seite stehen.

Key Takeaways

- Ein RAG-Modell (Retrieval-Augmented Generation) führt zunächst eine lokale Suche durch und verwendet dann die angereicherten Informationen als Input für ein Large Language Model (LLM).

- RAG-Modelle bieten Vorteile in Bezug auf Sicherheit und Datenschutz.

- Da eine Suche vorangestellt wird, ist es entscheidend, dass die Sicherheitseinstellungen lückenlos sind und keine Datenfriedhöfe durchsucht werden.

- M365 Copilot basiert auf einem RAG-Modell.

👉 Demnächst auf unserem Blog:

Im nächsten Blog sieben «Der Billion-Dollar Boost: AI & LLMs für Entscheidungsträger» nehme ich unter die Lupe, weshalb die Erwartungen betreffend Produktivitäts-Boost so enorm gross sind. Sei gespannt und bleibe dran.

Stelle sicher, dass du keinen Beitrag aus dieser achtteiligen Serie verpasst und in Zukunft direkt über Neuigkeiten im Bereich Künstliche Intelligenz informiert bleibst. Registriere dich jetzt für das kostenlose Blog-Abo.

✍️✍️✍️

Wenn du weitere Fragen hast, zögere nicht und kontaktiere uns. Wir helfen dir gerne unter marketing@bithawk.ch weiter.